农业深度视觉:评估YOLO在植物叶片病害(PLDs)分类中的作用(Yolo全系列解析)

- 2026-05-21 04:47:54

点击蓝字

关注我们

关注并星标

从此不迷路

公众号ID|计算机视觉研究院

学习群|扫码在主页获取加入方式

计算机视觉研究院专栏

Column of Computer Vision Institute

植物叶片病害一直是农业领域的重大难题,会造成严重的产量损失,威胁粮食安全。病害的早期检测至关重要,而深度学习领域近年来的研究成果为实现自动化、高精度检测方案提供了可能。其中应用最广泛、最常用的是YOLO(YouOnlyLookOnce)系列目标检测模型,该系列模型已被用于植物病害的实时检测。

PART/1

概述

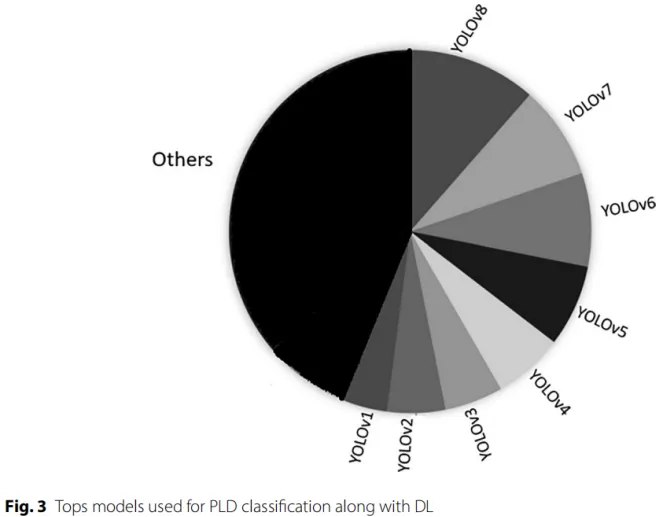

本文对基于YOLO的检测方法进行了全新、深入的综述,涵盖从YOLOv1到YOLOv10的各版本模型,以及面向特定应用场景的改进模型,包括香菜病害检测的CTB-YOLO、基于YOLOv10n的BED-YOLO、适用于咖啡病害检测且融合RAG增强策略的YOLOv8等。与现有综述相比,本文的创新点在于:(1)构建了结构化数据集目录,汇总了数据集规模、图像分辨率、病害类别及存在的问题(如样本不均衡、标注缺陷等);(2)针对不同版本YOLO模型的精度、精确率、召回率、F1值、平均精度均值及帧率等性能指标开展对比基准分析,揭示了模型速度与精度间的权衡关系;(3)前瞻性探讨了当前研究面临的挑战与未来研究方向,包括可部署于移动端的轻量化YOLO模型等。本文可为相关研究提供系统性参考,同时为面向可持续农业的基于YOLO的植物叶片病害检测技术发展提供新的研究思路与支撑。

PART/2

背景

植物叶片病害(PLD)检测已成为农业技术领域最重要的研究课题之一,因其直接影响作物产量、粮食安全与可持续农业生产。及时、准确地检测叶片病害,有助于尽早采取防控措施,最大限度减少作物损失,同时避免农药滥用。

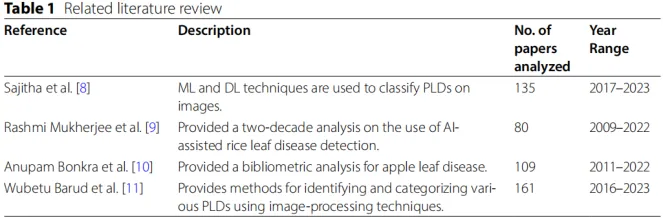

本文采用系统性综述方法,梳理并解析了科研文献中用于植物叶片病害分类的深度学习算法。文献检索在ScienceDirect、IEEE、Springer等数据库中完成,检索词与研究主题高度相关。本文核心目标是总结当前基于深度学习(包括各类YOLO改进模型)的植物叶片病害研究进展,构建了全面的植物叶片病害识别相关文献库。本文主要贡献如下:

l对深度学习在叶片病害分类与检测领域的研究文献开展更全面、前沿的综述,涵盖136篇文献及多种深度学习算法,并进行对比与讨论;

l分析深度学习在植物叶片病害研究中采用的评估指标,便于后续研究理解与复现实验结果;

l展示用于植物叶片病害检测与分类的深度学习架构;

l深入剖析将深度学习方法应用于植物叶片病害识别与分类时的主要局限、挑战与潜在发展路径;

PART/3

新框架解析

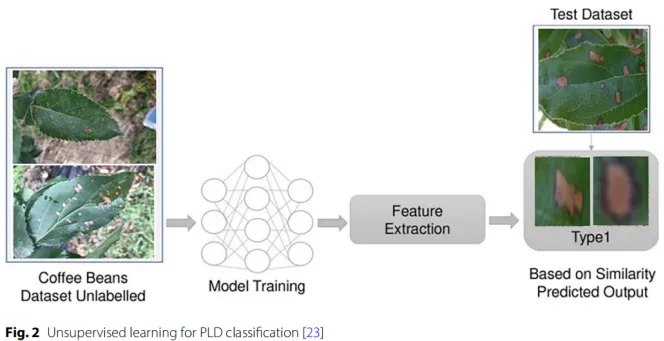

用于植物叶片病害识别的深度学习方法

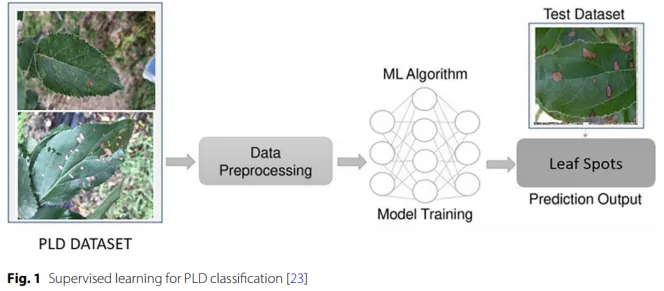

深度学习(DL)是人工智能的一个分支,它能够通过从训练数据中学习泛化规律,对未知数据实现准确分类与预测,是适用于所有需要数据分析领域的灵活工具。深度学习是采用人工神经网络结构的机器学习分支。人工神经网络(ANN)通过被称为神经元的多层互联节点处理输入数据并从中学习,每个神经元均接收输入层或上一层神经元传递的信息。

情感分析、语言翻译、图像分类与识别等诸多监督学习任务,均采用卷积神经网络、循环神经网络等深度学习方法;生成模型、自编码器等深度学习算法则用于异常检测、降维、聚类等无监督学习任务。机器人、游戏等领域则借助深度确定性策略梯度(DDPG)、深度Q网络等深度强化学习方法实现优化。

深度学习模型可从输入数据中自主提取特征,是图像识别、语音识别、自然语言处理等任务的理想选择。目前应用最广泛的三种深度学习架构为卷积神经网络(CNN)、前馈神经网络(FNN)和循环神经网络(RNN)。前馈神经网络是最基础的人工神经网络,采用线性信息流,已广泛应用于自然语言处理、图像分类、语音识别等任务。卷积神经网络专为图像、视频识别任务设计,可自动学习图像特征,完美适配目标检测、图像分割、图像分类等应用场景。时间序列、语音属于序列数据,这类数据适合由循环神经网络处理,该网络可保留包含历史输入信息的内部状态,是语音识别、自然语言处理、机器翻译等任务的优选方案。

计算机视觉是人工智能的重要领域,旨在从图像中解析、破译并提取有效信息以完成决策。实现目标的通用识别具有较高难度,而在图像或视频中定位特定目标即为计算机视觉中的目标检测。该任务的两大核心目标是目标定位(确定目标在图像中的精确位置)与目标分类(判定图像中目标的类别,包括叶片病害的类型与严重程度)。目标检测技术可极大助力植物叶片病害分类,提升检测效率与精度。计算机视觉任务能够从图像和视频中识别叶片病害,依据病斑特征区分不同类型的受损叶片,借助YOLO等目标检测技术,可实现植物叶片病害的多类别自动分类。

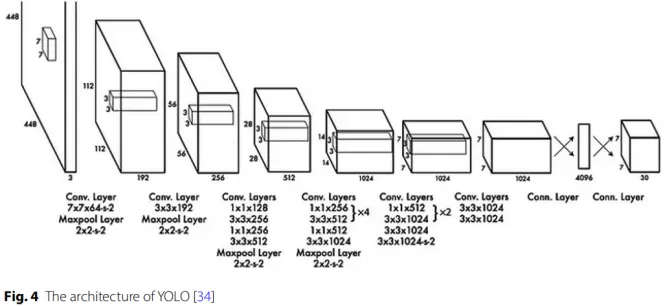

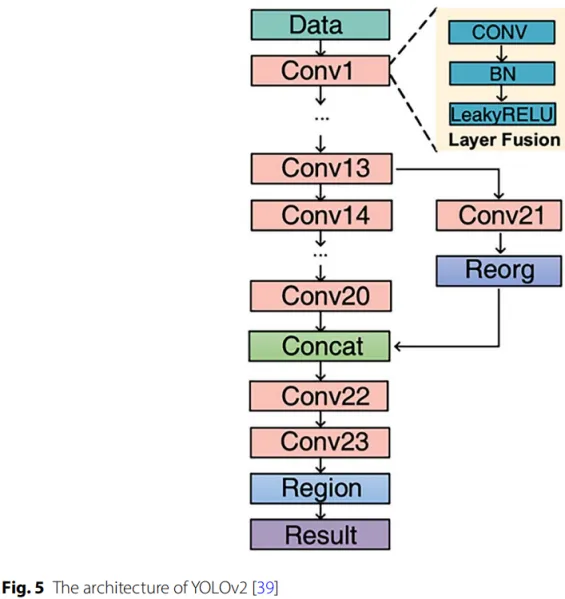

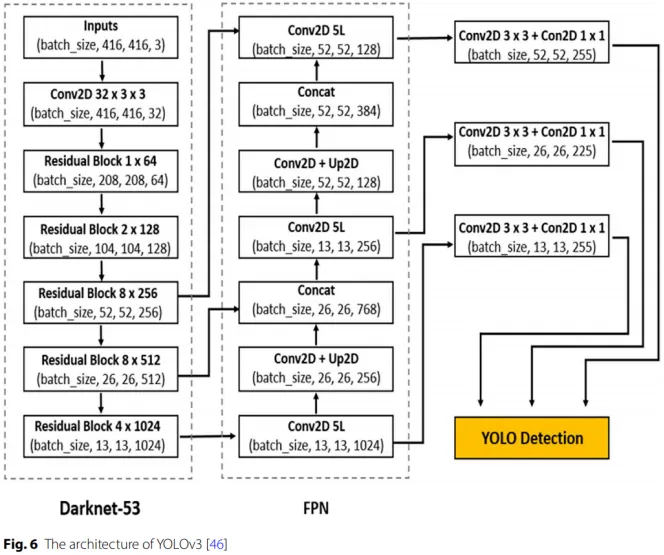

YOLO借鉴GoogLeNet架构,摒弃原有的inception模块,创新采用1×1卷积与3×3卷积核组合的设计,采用Darknet框架进行训练,并在2007年与2012年的VOCPascal数据集上完成性能验证。YOLO的核心特性为采用1×1卷积与全局平均池化,共计24个卷积层,其中仅4层后连接最大池化层。模型在ImageNet数据集完成预训练后,新增两个随机初始化权重的全连接层与四个卷积层进行微调,除输出层采用线性激活函数外,其余层均使用带泄露修正线性单元(LReLU)激活函数。

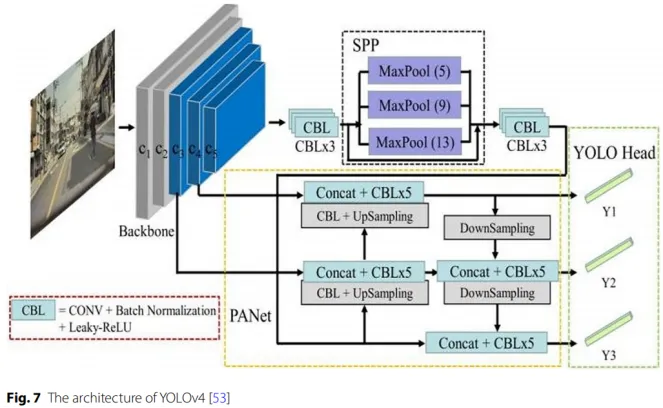

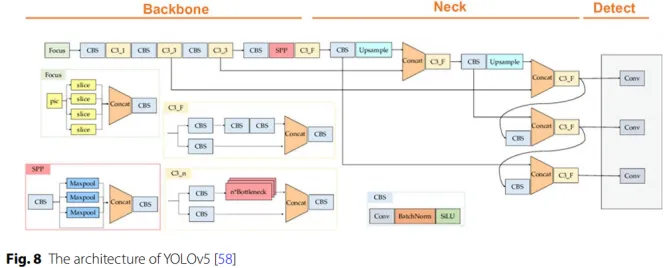

YOLOv5由Ultralytics团队推出,是YOLO系列的里程碑式版本,凭借易用性、易获取性与实时目标检测的优异性能迅速普及。YOLOv5基于PyTorch框架开发,易于使用、训练与部署,架构延续YOLOv4的核心设计,同时集成全新的优化与简化方案,在提升效率的同时实现优异检测效果。YOLOv5提供多种型号(YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x),不同型号的主干网络深度与宽度不同,这种模块化设计实现了速度与精度的灵活权衡,适配多样化应用场景。YOLOv5在网络起始端引入聚焦层(FocusLayer),将输入图像切分为四部分后拼接生成特征图,使空间维度缩减一半、通道数扩充四倍,节省计算资源并提升运算效率。主干网络采用基于跨阶段局部网络(CSPNet)的模块划分特征图,优化梯度传播与计算效率。颈部网络与YOLOv4一致采用路径聚合网络(PANet),融合不同层级与尺度的特征,提升多尺度检测能力。每个检测头输出边界框坐标、目标置信度与类别概率,其网络结构如图8所示。

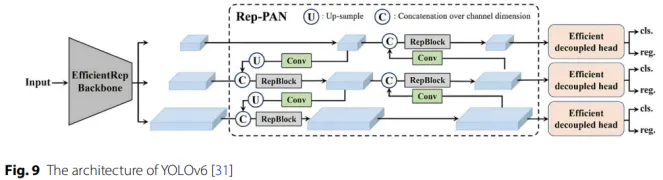

YOLOv6由美团于2022年推出,该模型针对工业部署环境与实时应用场景进行了优化设计,提升了目标检测性能。YOLOv6通过一系列架构调整、训练策略优化与技术改进,在GPU上实现了高精度检测的同时,保持了高效的推理速度。其设计融合了主干网络、颈部网络与检测头的全方位改进,在提升性能的同时降低计算成本。此外,该模型还引入了增强型数据增强策略、损失函数以及无锚框检测机制。YOLOv6采用基于重参数化VGG(RepVGG)结构设计的EfficientRep主干网络。RepVGG模块运用重参数化技术,在推理阶段将复杂结构转化为简单卷积模块,实现架构简化。重参数化技术使得YOLOv6在训练时可融合多路卷积,推理时则精简为单路卷积,有效优化了推理速度与内存利用率。YOLOv6中的双向特征金字塔网络(BiFPN)针对轻量化场景进行了优化,在不显著增加推理耗时的前提下,实现了更优的多尺度特征融合效果。其网络结构如图9所示。

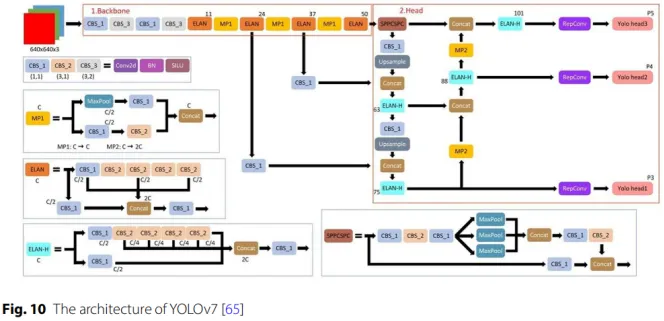

YOLOv7是YOLO系列的又一重大突破,将实时目标检测的性能推向新高度,兼顾检测效率与精度。YOLOv7引入多项创新技术,在不牺牲检测速度的前提下提升模型精度,成为实时目标检测应用中性能最强大的YOLO版本之一。YOLOv7的架构在主干网络、颈部网络与检测头均做了改进,通过结构革新与创新训练策略提升精度与速度,网络结构如图10所示。

YOLOv7沿用了YOLOv4与YOLOv5中采用的跨阶段局部网络(CSPNet),该网络将特征图分为两部分,对其中一部分进行多层序列处理后再与另一部分融合,以此提升特征学习效率。这种结构优化了梯度传播,可在不增加计算复杂度的情况下构建更深的网络。YOLOv7在主干网络中引入了高效长程注意力网络(ELAN)结构,通过堆叠多个不同卷积核尺寸的卷积层,使模型能够学习并融合多尺度特征,让网络更易识别不同尺寸、不同朝向的目标。同时,YOLOv7还引入了改进型局部卷积结构,进一步提升运算效率,其网络结构如图10所示。

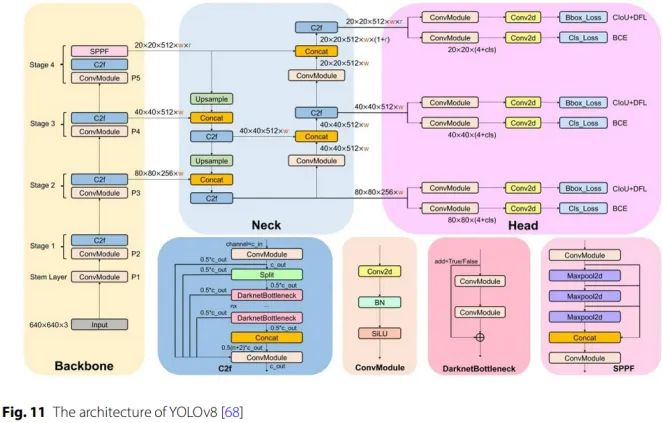

YOLOv8的主干网络为CSP-Darknet,是跨阶段局部网络(CSP)的改进版本。CSP层将特征图划分为两部分,采用跨阶段局部处理的方式,在降低计算量的同时提升特征学习能力。

用于叶片锈病识别的YOLO模型

YOLO将图像中的目标检测任务视为回归问题,以图像为输入,直接输出目标位置与类别。相较于传统目标检测算法,YOLO的优势在于:可学习目标的泛化特征表示、基于全局图像完成检测、运行速度快。

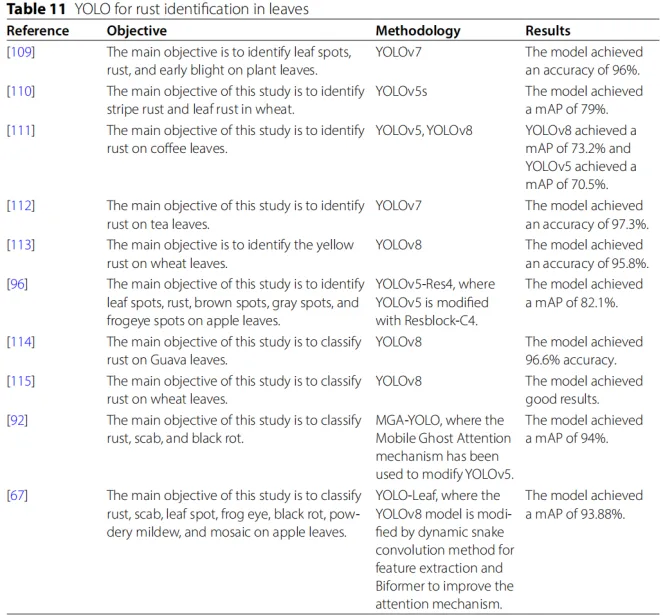

如表11所示,表格第一列为参考文献,其后依次为研究目标、研究方法与实验结果。

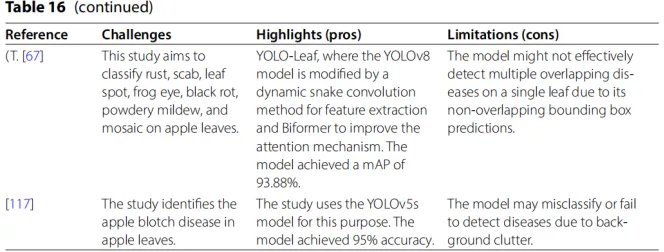

用于其他植物叶片病害分类的YOLO模型

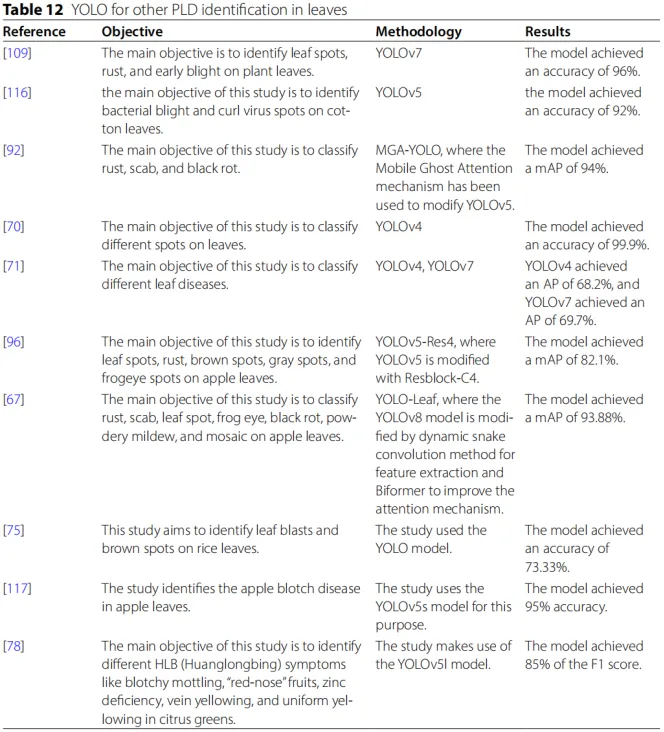

如表12所示,表格第一列为参考文献,第二列为研究目标,第三列为研究方法,最后一列详细展示实验结果。

PART/4

基准测试与对比分析

不同YOLO版本对比

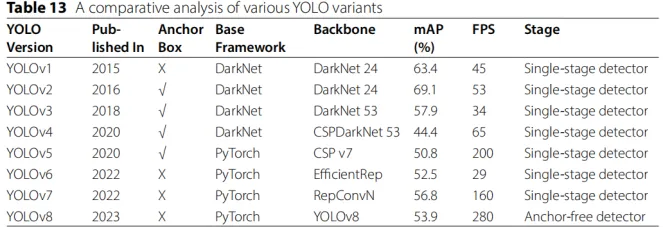

本部分对YOLOv1至YOLOv8各版本进行对比分析,各版本在不同评估指标下的对比结果如表13所示。

YOLO初代版本YOLOv1首次提出基于锚框、单阶段架构的实时目标检测革新思路,其DarkNet-24架构以45帧每秒的速度处理数据,平均精度均值达到63.4%的优异水平。YOLOv2在YOLOv1的基础上延续锚框设计,提升定位精度,同样采用DarkNet-24架构,在保持实时处理能力的同时,平均精度均值大幅提升至69.0%,帧率达52帧每秒。YOLOv3采用多尺度特征提取架构,引入CIoU、GIoU、二元交叉熵等新型损失函数,实现速度与精度的均衡,基于Darknet-53架构,以34帧每秒的速度完成多尺度目标检测,平均精度均值为57.9%。YOLOv4侧重应用CIoU、分布焦点损失、二元交叉熵等复杂损失函数,引入CSPDarknet-53架构,在保证实时处理的同时提升边界框检测精度,尽管平均精度均值降至44.3%,但帧率仍高达65帧每秒。YOLOv5基于PyTorch框架构建改进型CSP-v7架构,精度与效率大幅提升,采用单阶段检测结构与专属损失函数(CIoU、DFL、BCE),平均精度均值达50.7%,帧率更是提升至200帧每秒,在实时应用中表现出色。

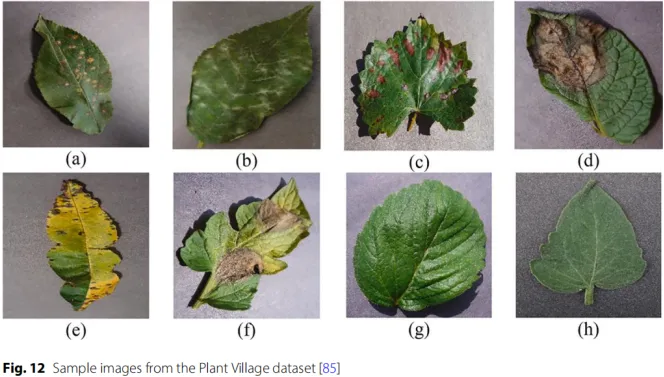

不同YOLO版本的性能评估

本部分基于PlantVillage数据集对各YOLO版本进行对比。数据集在研究中至关重要,PlantVillage是植物病害分类与检测任务中常用的标准数据集,其构建目的是支撑农业技术研究,尤其是基于机器学习与深度学习模型的植物叶片病害识别研究。该数据集包含健康与染病植株叶片图像,覆盖苹果、番茄、马铃薯、葡萄、玉米等多种作物,包含晚疫病、锈病、霉病、细菌性斑点病等常见病害,总计约5.5万张健康与染病叶片图像,共38个类别,图12展示了该常用数据集的部分样本图像。

本部分在该数据集上训练YOLOv1至YOLOv8模型并对比性能。目标检测器的效果可通过多项指标评估,包括平均精度、准确率、精确率、F1分数、平均精度均值与召回率。其中,平均精度(AP)是基于召回率与精确率计算的最常用统计指标。目标检测器通过在图像或视频中标记高置信度的边界框,定位特定类别目标,完成目标位置预测。完整检测任务包含三个要素:目标类别、包围目标的锚框、置信度。

PART/5

挑战与未来方向

植物叶片病害检测领域的后续研究,需通过模型剪枝、量化、知识蒸馏等技术,研发可部署于移动设备与边缘传感器的轻量化YOLO模型,让农户可在终端设备上完成作物病害的实时诊断。另一大发展趋势是,将YOLO、无人机与物联网平台融合,结合航拍成像与传感数据,实现宏观到微观尺度的全域监测。为提升模型易用性,引入显著图、梯度加权类激活映射等可解释人工智能特性,可视化驱动模型预测的叶片关键敏感区域,增强用户信任度,具有重要研究价值。跨域自适应同样值得关注:在精制数据集上训练的模型,在真实田间场景中性能往往不佳,迁移学习、域自适应、多模态融合(如RGB图像结合高光谱或热成像数据)等方法,在提升模型泛化性上具备潜力。最后,现有数据集标注信息稀缺,因此发展半监督神经网络、生成对抗网络等合成数据生成技术,可在减少人工标注依赖的前提下,扩充数据规模并提升模型泛化能力。

END

转载请联系本公众号获得授权

计算机视觉研究院学习群等你加入!

ABOUT

计算机视觉研究院

🔗

YOLO-TLA:一种基于 YOLOv5 的高效轻量级小目标检测模型 ViT-YOLO:基于Transformer的用于目标检测的YOLO算法 SSMA-YOLO:一种轻量级的 YOLO 模型,具备增强的特征提取与融合能力,适用于无人机航拍的船舶图像检测 LUD-YOLO:一种用于无人机的新型轻量级目标检测网络 Gold-YOLO:基于聚合与分配机制的高效目标检测器 Drone-YOLO:一种有效的无人机图像目标检测 「无人机+AI」“空中城管” 无人机+AI:光伏巡检自动化解决方案 无人机视角下多类别船舶检测及数量统计 机场项目:解决飞行物空间大小/纵横比、速度、遮挡等问题引起的实时目标检测问题 2PCNet:昼夜无监督域自适应目标检测(附原代码) YOLO-S:小目标检测的轻量级、精确的类YOLO网络 大改Yolo框架 | 能源消耗极低的目标检测新框架(附论文下载) 改进的检测算法:用于高分辨率光学遥感图像目标检测